HiGCIN: Hierarchical Graph-based Cross Inference Network for Group Activity Recognition(TPAMI 2020)

引言分析

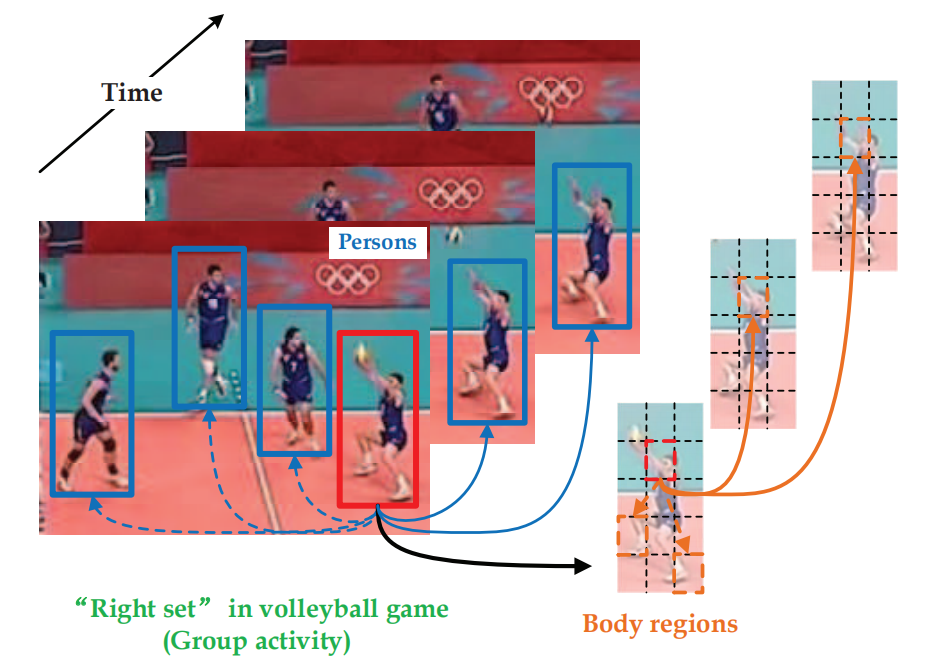

在组行为识别中,为了对组行为进行推理,我们需要获取包括身体区域,人,以及它们之间的联系的各种信息。个体行为与群里行为是强耦合的,而之前的一些方法使用了两阶段的pipeline,将个体行为与群里行为的推导相割裂,或者说传统方法忽略了人与人之前的潜在的时空依赖,只考虑了空间情景。同时,这些方法也没有考虑身体区域之间的时空依赖。

因而论文提出了一个泛用的十字推理块(CIB)来利用隐藏在特征结点之间的时空依赖。基于CIB,作者提出了群体行为识别框架HIGCIN。设计了 推理身体区域之间依赖的BIM和人之间依赖的PIM。

核心亮点

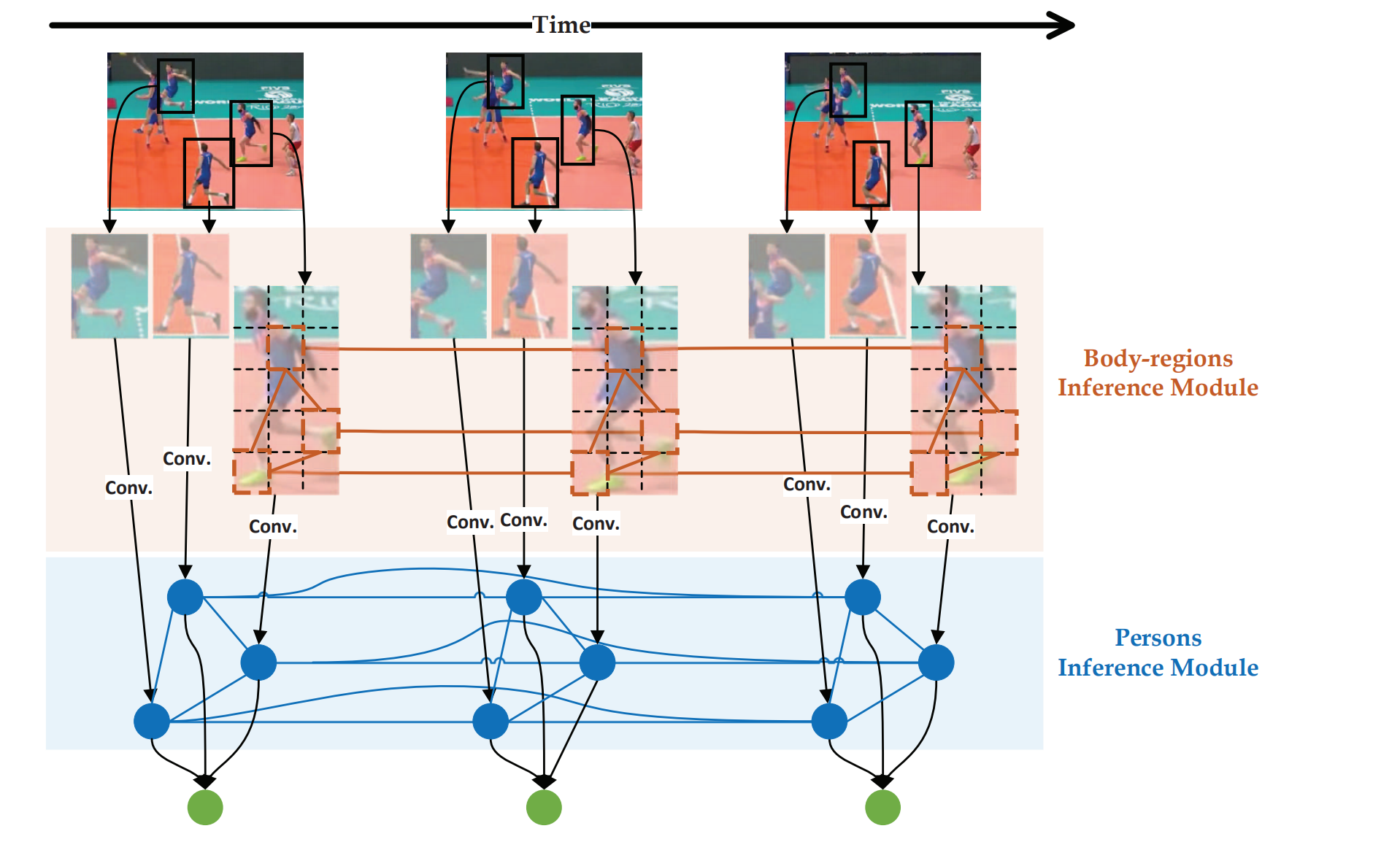

网络整体架构

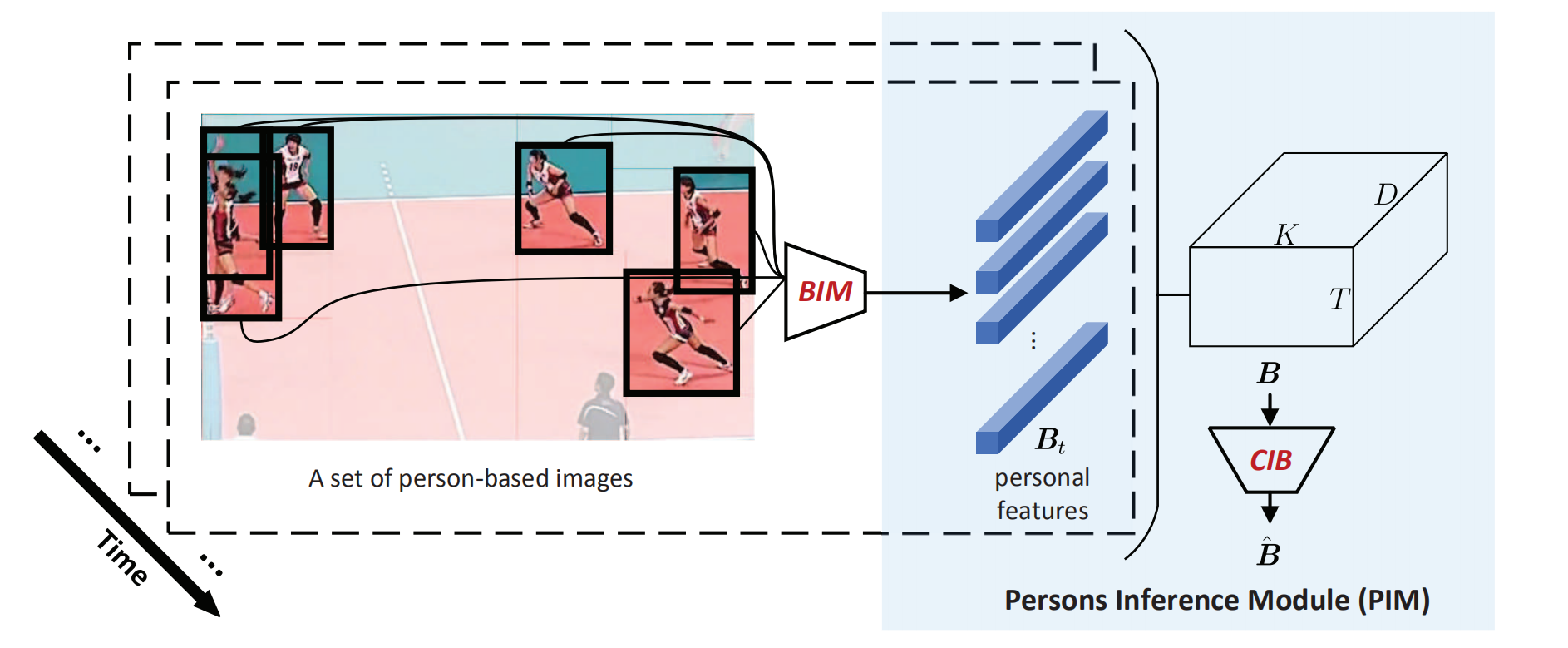

如图所示,BIM模块考虑了固有的身体区域之间的时空联系,提取每个人的卷积特征。在这之后,使用PIM模块进一步探索人之间特征的时空依赖。最终每个帧的所有特征都被max-pooled到了单个向量。

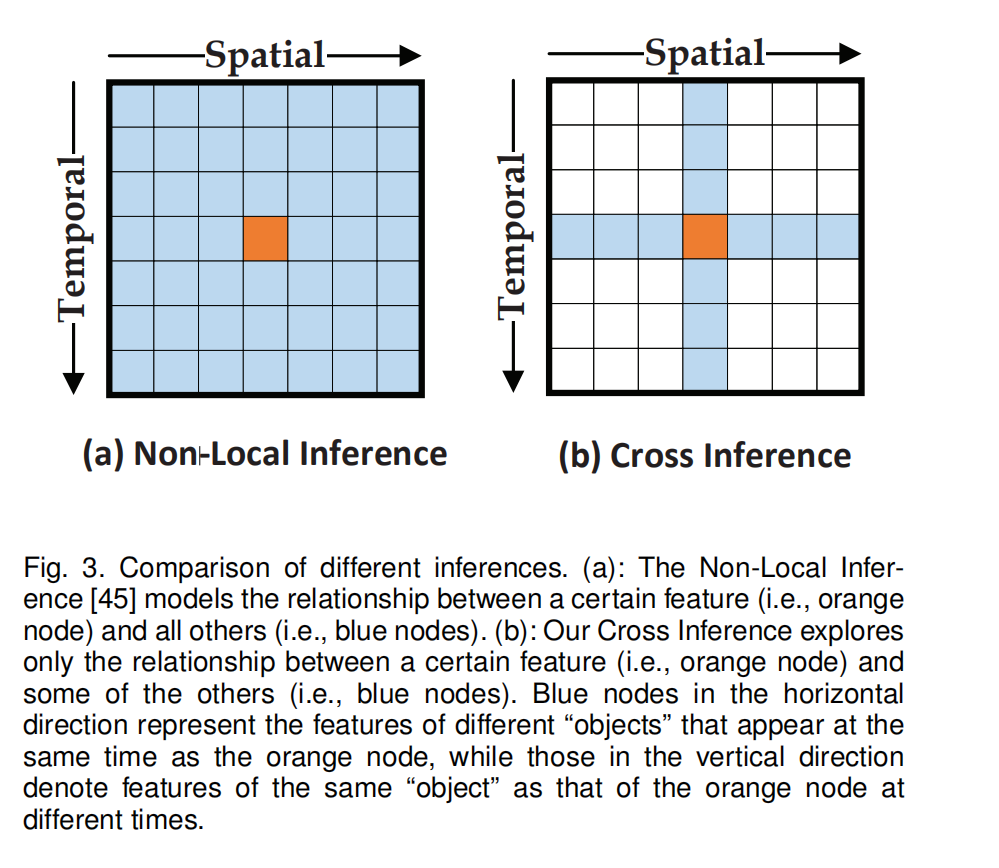

十字推理

受到non-local网络的启发,时空共时依赖可以通过非局部推理得到,本文提出了一种新的推理方式十字推理,去掉了很多不必要的连接。

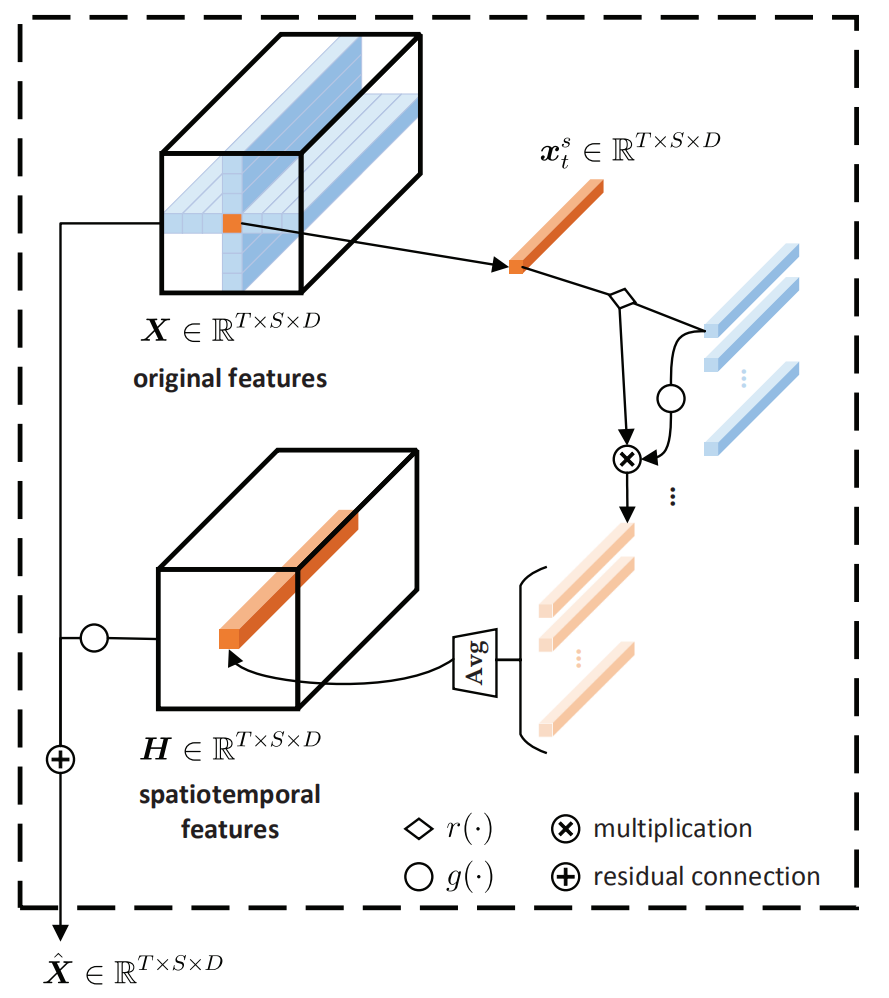

CIB

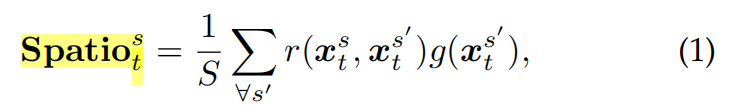

在时间t,第s个特征节点

s’为所有在空间域可能与其有交互的其他结点。r用来计算任意两个特征的空间依赖,g是线性变换。

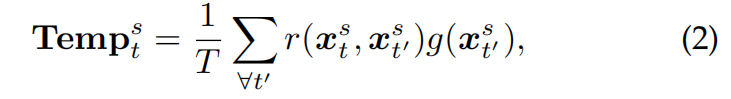

同理,时间表示为:

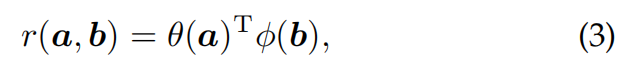

二元函数r一般采用点积相似度:

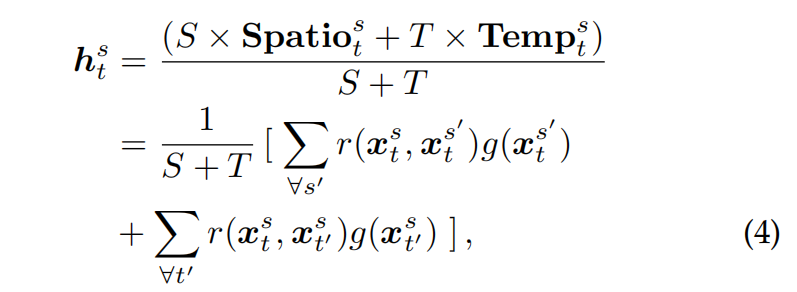

通过结合空间表示和时间表示,我们可以得到:

它包含了时空共时依赖信息。之后作者用了残差连接来将设计的block包含进现有的深度架构中:

该CIB模块可以被拓展至探索身体区域之间与人之间的联系。

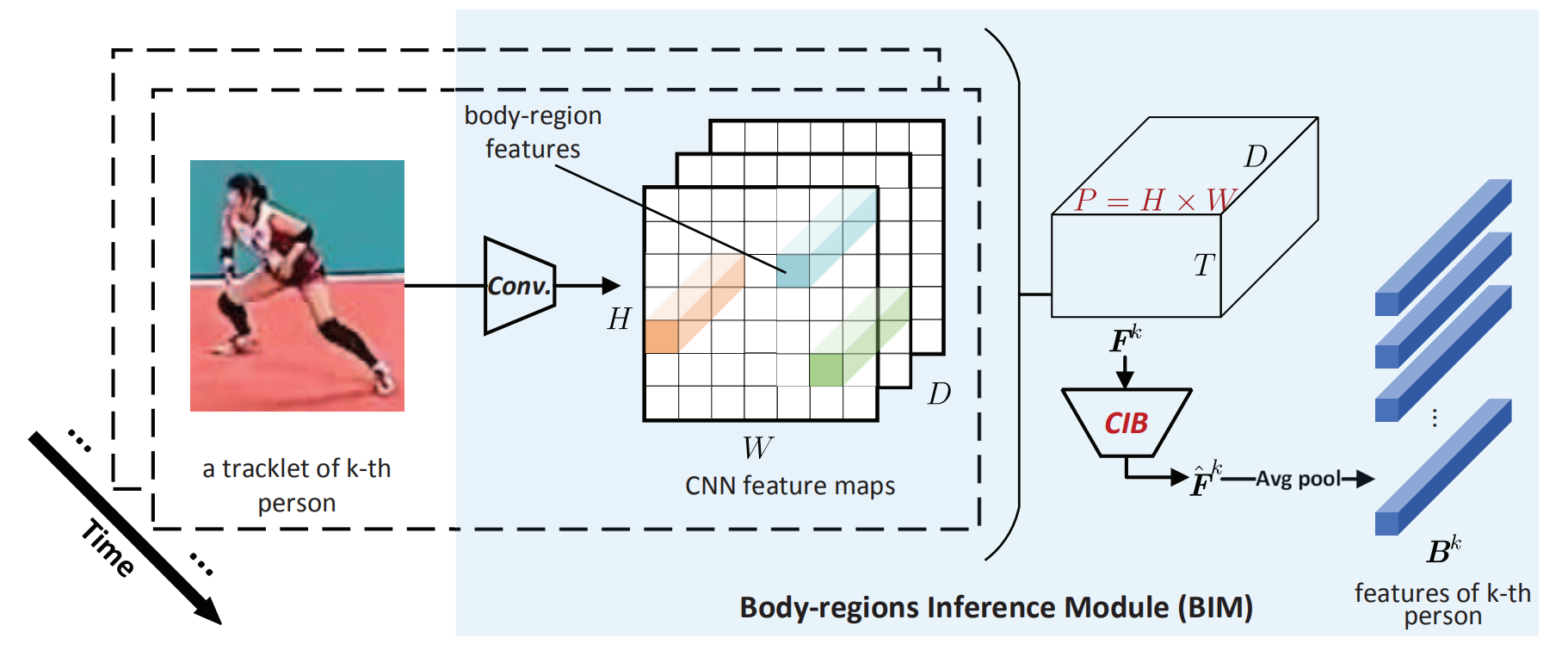

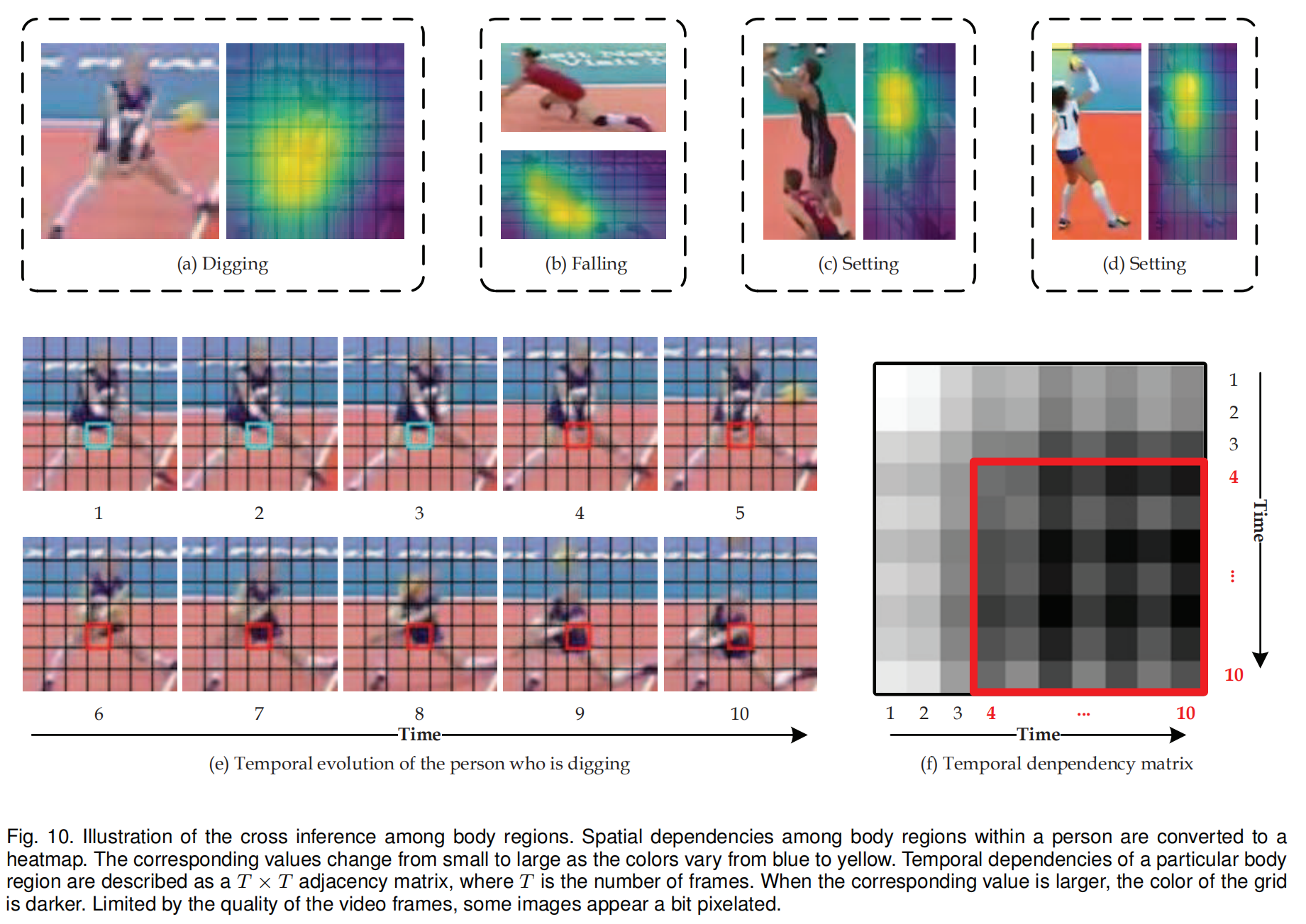

BIM

作者认为人的结构信息个体行为的特征表示有一定帮助。首先使用CNN得到大小为

通过平均池化,我们即可得到第k个人的特征

整个过程如下图所示:

PIM

同理,通过上一步得到B之后,可通过如下的公式计算人之间的联系:

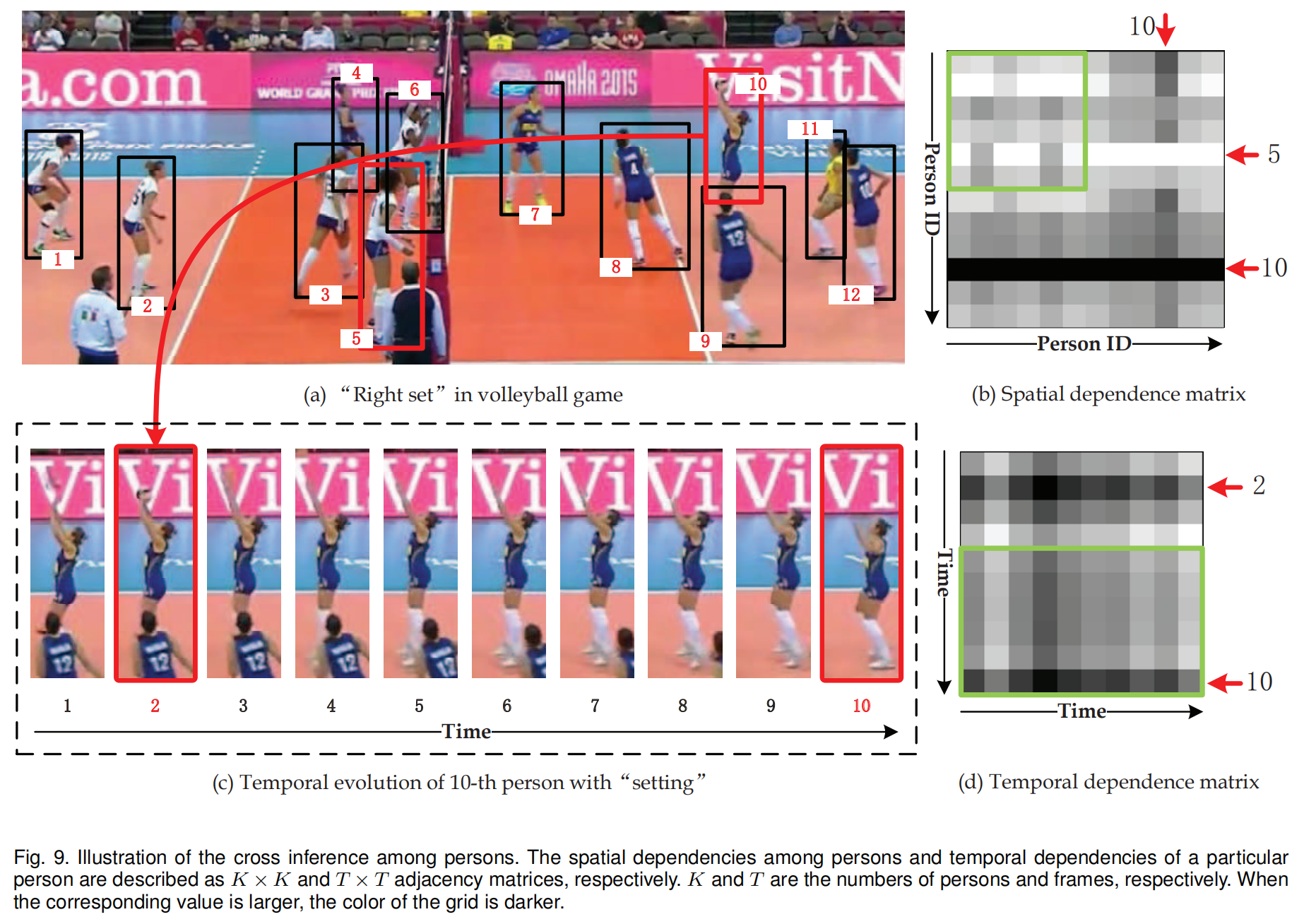

过程如下图所示:

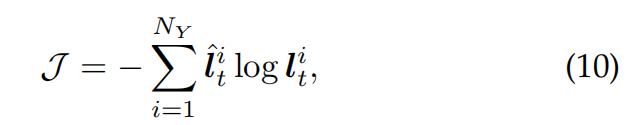

最终的loss函数定义如下:

NY代表群体行为的类别数,lt是预测,带帽子的是真值。

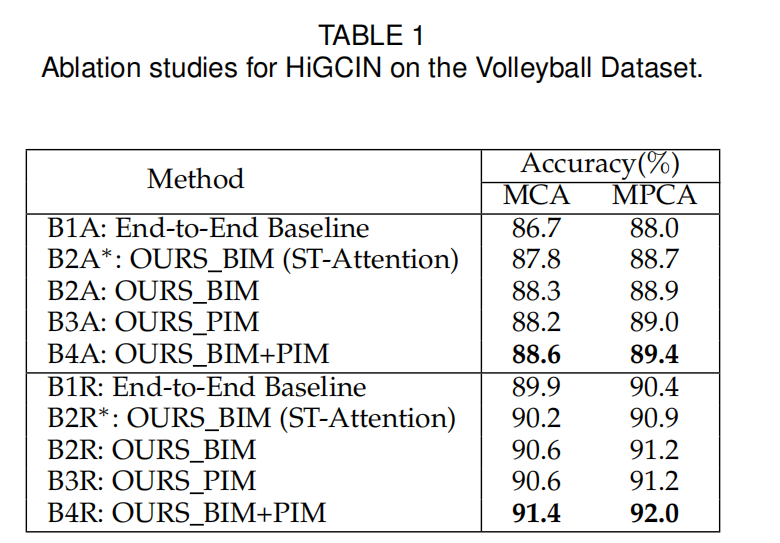

实验结果

指标

MCA:正确预测的百分比

MPCA:每个类别的平均准确率

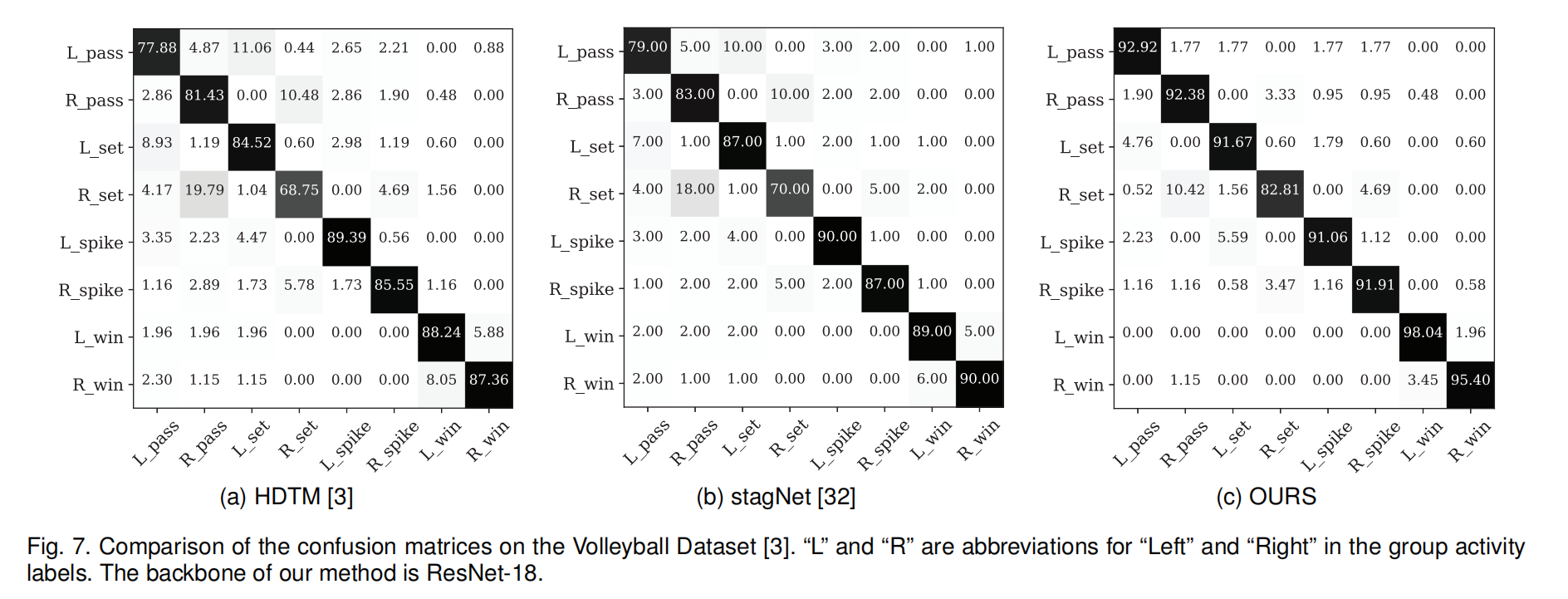

混淆矩阵

实验组对比

- b1:基线

- b2:使用BIM

- b3:使用PIM

- b4:同时使用BIM和PIM

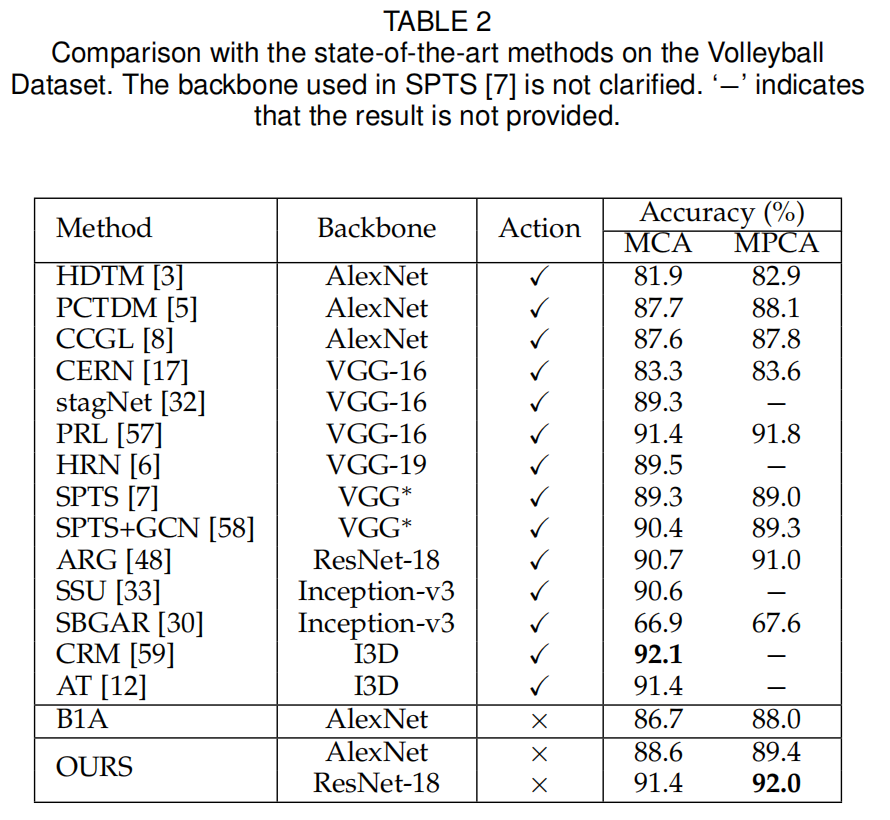

SOTA对比

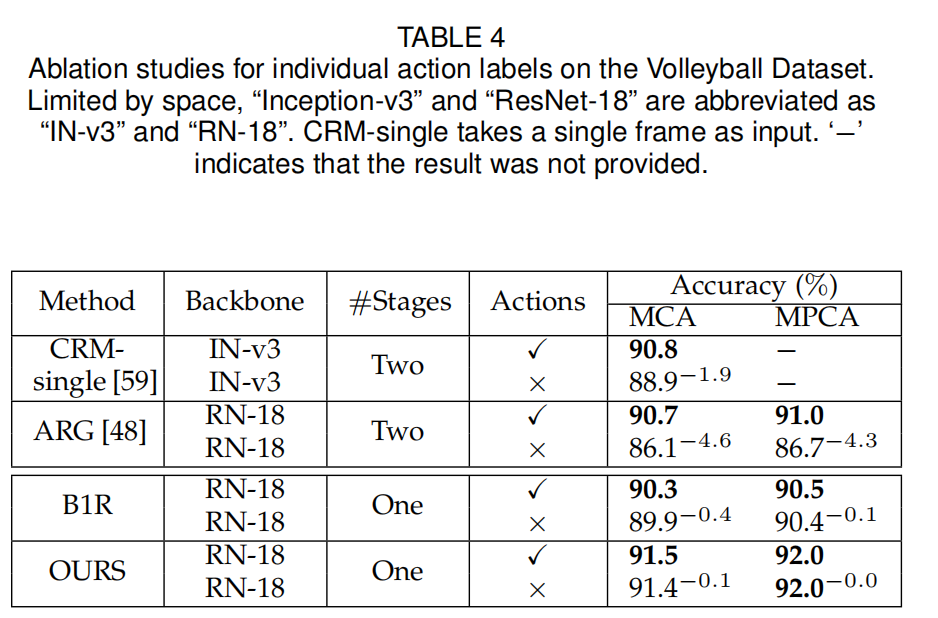

是否加入个体标签对实验的影响

混淆矩阵

可视化

上面矩阵是根据r函数计算得到的。

- Post title:论文阅读笔记:“HiGCIN: Hierarchical Graph-based Cross Inference Network for Group Activity Recognition”

- Post author:sixwalter

- Create time:2023-08-05 11:14:26

- Post link:https://coelien.github.io/2023/08/05/paper-reading/paper_reading_044/

- Copyright Notice:All articles in this blog are licensed under BY-NC-SA unless stating additionally.